[논문리뷰] From Blind Spots to Gains: Diagnostic‑Driven Iterative Training for LMMs

논문 정보

- 제목: From Blind Spots to Gains: Diagnostic‑Driven Iterative Training for Large Multimodal Models

- 저자: Hongrui Jia 외

- 연도: 2026

- 링크: https://arxiv.org/abs/2602.22859

Introduction (배경/문제의식)

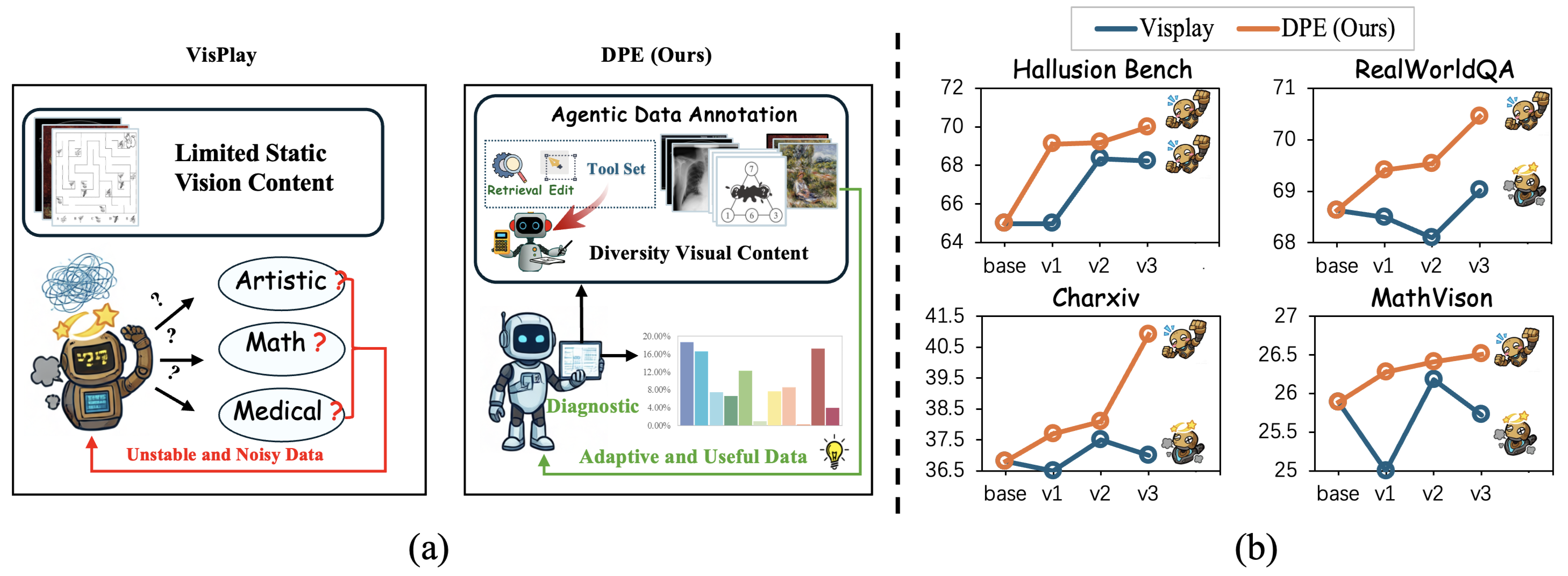

대형 멀티모달 모델(LMM)은 추론 성능이 올라왔지만, 학습은 여전히 정적 데이터/고정 레시피에 의존한다. 그 결과 모델이 **어느 능력에서 막히는지(Blind Spot)**를 파악하기 어렵고, 보완도 비효율적이다.

이 논문은 “진단 → 맞춤 데이터 생성 → 강화학습”의 반복 루프를 통해, 모델 성능을 지속적으로 끌어올리는 학습 방식을 제안한다.

핵심 아이디어 (DPE 루프)

DPE(Diagnostic‑driven Progressive Evolution)는 다음의 반복 구조를 가진다.

- Diagnosis: 실패를 약점 유형으로 분류

- Data Evolution: 약점 중심 데이터를 에이전트가 생성/정제

- RL Reinforcement: 해당 데이터로 재학습

- 다시 진단 → 반복

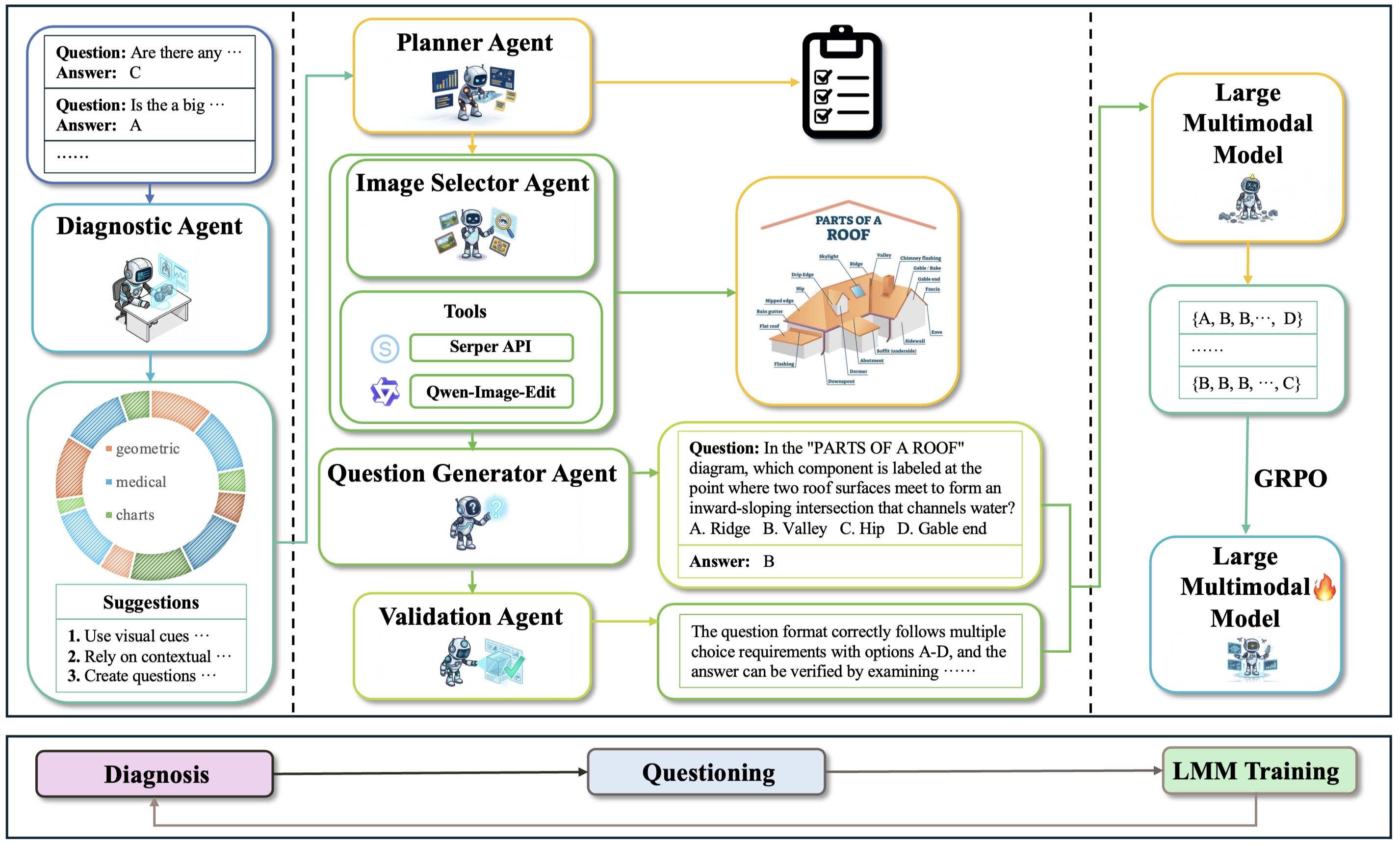

Figure 2. Overview of the DPE framework

Figure 2. Overview of the DPE framework

Section: System Components

논문은 다중 에이전트 구조를 제시한다. Planner는 목표와 계획을 잡고, Image Selector는 적절한 시각 입력을 고르며, Question Generator가 평가 질문을 만든다. 마지막으로 Validation Agent가 정답을 검증하고 품질을 보장한다.

이 구조 덕분에 단순한 자기생성보다 목표 지향적이고 검증 가능한 데이터가 만들어진다고 주장한다.

Section: Data Evolution & RL

DPE는 약점 중심 데이터를 생성하고 이를 RLVR/GRPO 등 강화학습으로 연결한다. 중요한 점은 데이터 믹스를 동적으로 조정한다는 것이다. 예를 들어 특정 유형의 오류가 늘어나면 그 유형 데이터를 비중 있게 투입해 약점을 교정한다.

이는 정적 데이터셋에 의존하는 기존 학습과 달리, 학습 과정이 스스로 진화하는 구조라는 점이 특징이다.

Results & Discussion (논문 요약 기반)

Qwen3‑VL‑8B‑Instruct 및 Qwen2.5‑VL‑7B‑Instruct에서 11개 벤치마크 전반 성능 향상을 보고한다. 특히 반복 루프를 통해 **지속적 개선(continual gains)**이 가능함을 강조한다.

즉, 진단 기반 학습은 단기 성능 개선뿐 아니라 장기적 성능 상승 곡선을 만들 수 있음을 시사한다.

Figure 1. Limits of prior self-evolution frameworks

Figure 1. Limits of prior self-evolution frameworks

Figure 5. UMAP visualization of data diversity

Figure 5. UMAP visualization of data diversity

Limitations (한계)

진단의 신뢰도가 낮으면 잘못된 약점 분류가 발생할 수 있고, 이는 편향된 데이터 루프로 이어질 위험이 있다. 또한 에이전트·도구 기반 데이터 생성은 비용이 높아 실전 대규모 적용에서 병목이 될 가능성이 크다.

도비의 의견

교육에서 “오답 진단 → 맞춤 학습”을 반복하는 구조와 유사해 직관적이다. 향후 연구에서는 진단 정확도와 성능 향상의 상관관계가 정량적으로 제시되어야 설득력이 커질 것이다.

참고