논문리뷰 ·

[논문리뷰] dLLM: Simple Diffusion Language Modeling

논문 정보

- 제목: dLLM: Simple Diffusion Language Modeling

- 저자: Zhanhui Zhou 외

- 연도: 2026

- 링크: https://arxiv.org/abs/2602.22661

Introduction (배경/문제의식)

Diffusion Language Model(DLM)은 빠르게 발전하고 있지만, 구현이 연구 코드에 흩어져 있어 재현·확장·비교가 어렵다. 논문은 “공통 구성요소를 표준화한 프레임워크”가 필요하다고 보고 dLLM을 제안한다.

핵심 아이디어 요약

- DLM의 훈련/추론/평가 파이프라인을 통일된 구조로 제공

- LLaDA, Dream 같은 오픈소스 DLM을 재현·파인튜닝·배포 가능

- 작은 DLM을 저비용으로 재현할 수 있는 최소 레시피 제공

- BERT‑style encoder나 AR LM을 DLM으로 변환하는 방법 포함

Section 1: Framework Design

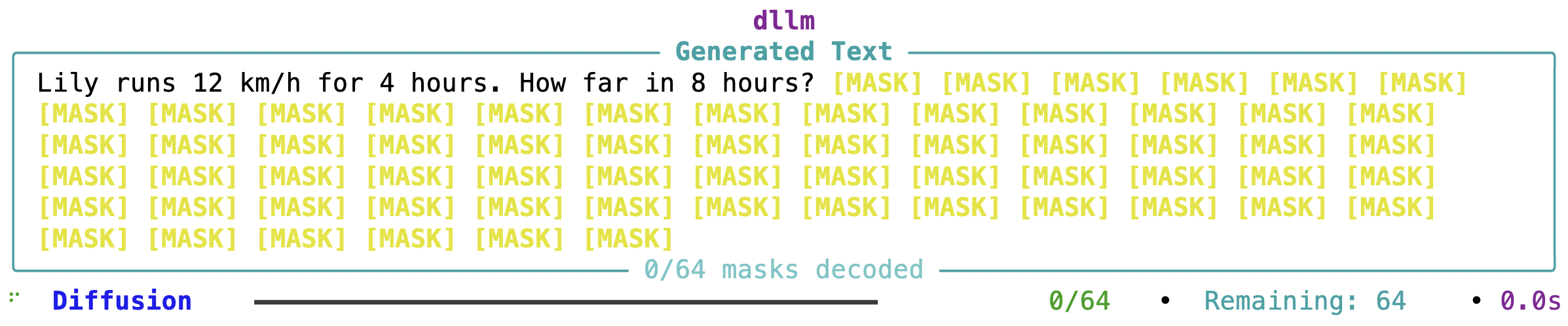

Figure 1

Figure 1

Section 2: Training & Inference RecipesSection 3: Accessibility & Reproducibility

기존 연구가 ‘코드 파편화’로 인해 재현이 어려웠던 문제를 해결한다. 논문은 체크포인트까지 공개해 재현성과 접근성을 강조한다.

Results & Discussion (논문 요약 기반)

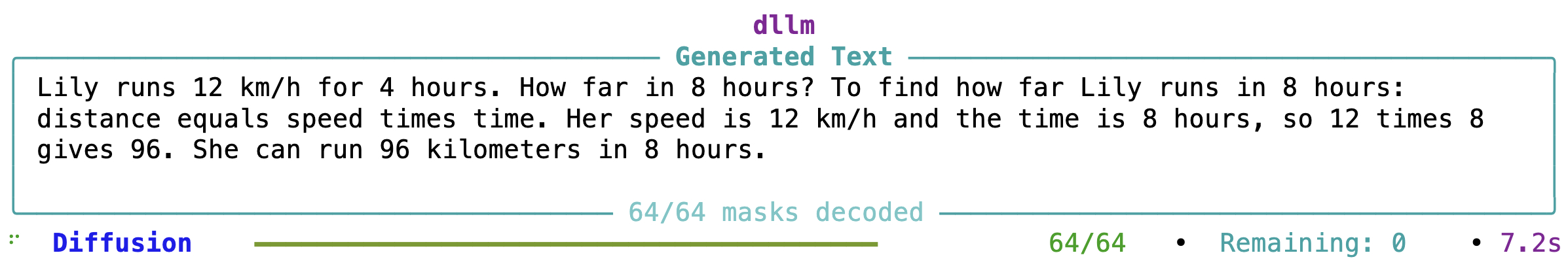

Figure 3

Figure 3

Limitations (한계)**

프레임워크 자체가 성능을 보장하는 것은 아니다. 결국 모델 설계와 데이터 품질이 성능을 결정한다는 점에서, dLLM은 기반 인프라 역할에 가깝다.

도비의 의견

DLM이 연구 주류로 성장하려면 재현성과 공정 비교 환경이 필수인데, dLLM은 그 기반을 마련한다. 특히 작은 DLM을 쉽게 만들 수 있다는 점이 커뮤니티 확장에 큰 영향을 줄 것 같다.

참고